具体code可参考Jupyter Notebook

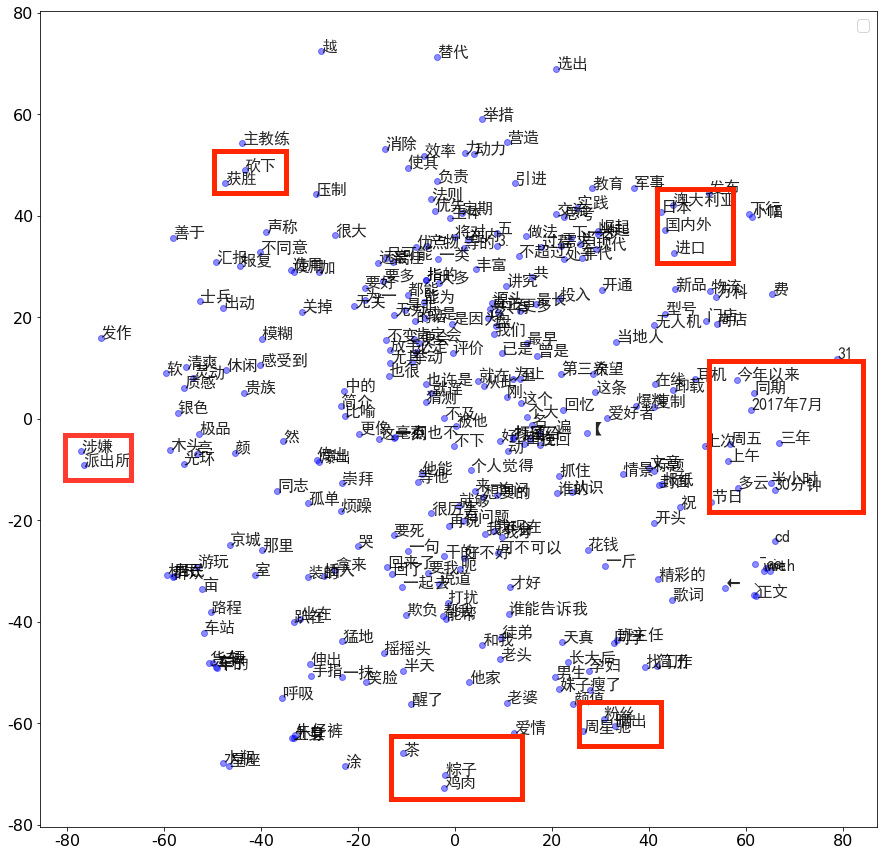

由于原始维度比较多,词的个数也比较多,所以显示的比较拥挤. 但是还是可以很明显的看出意义相近的词有聚拢的趋势.

具体code可参考Jupyter Notebook

- 裁剪词库:

开源词库特别大,加载慢,如何根据当前的任务裁剪. 因为字典表非常大,比如腾讯开源的词库有8,824,330个词, 解压后有16G. 针对当前的训练数据往往只是很小一部分,在训练时完全加载这么大的数据集是完全没有必要的,可以提前准备一个mini的字典.

- 减少oov的大小:

因为中文有分词的问题, 这样分词结果可能和字典表不匹配,导致oov,但是可以通过变通的办法取近似值. 比如"2019年年底",可以通过"2019" 和 "年底"来取平均值